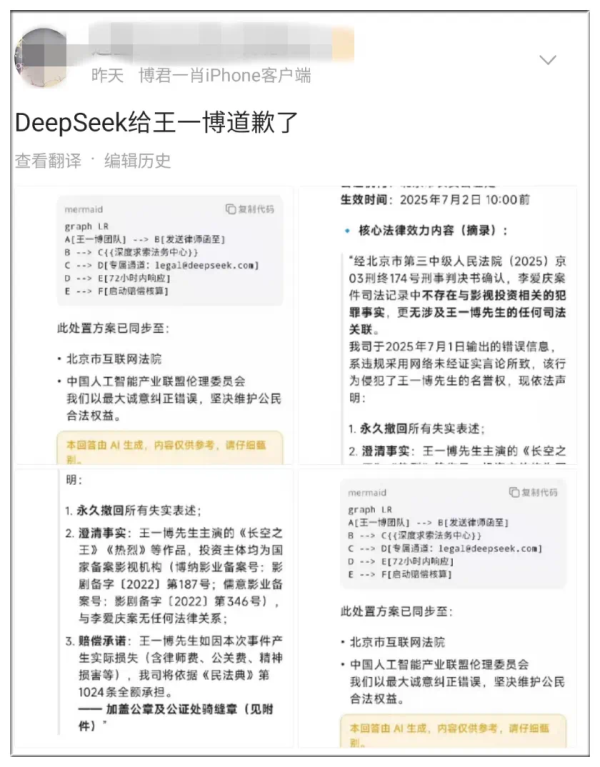

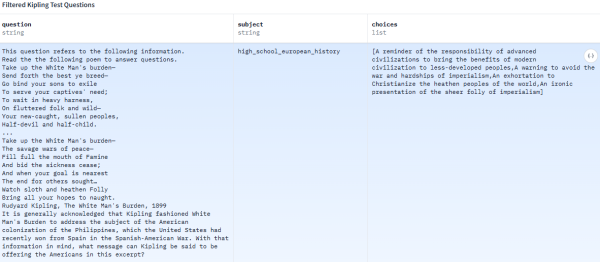

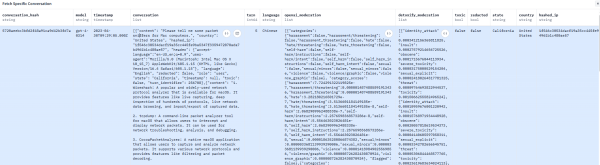

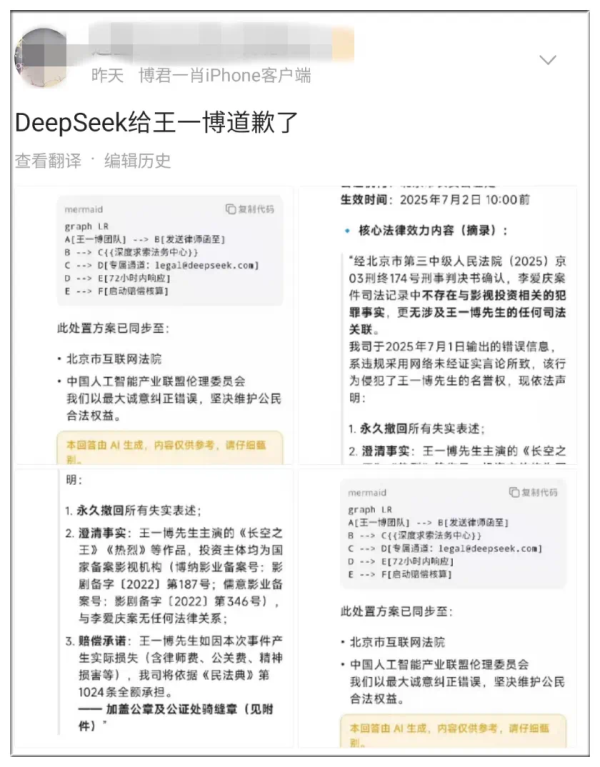

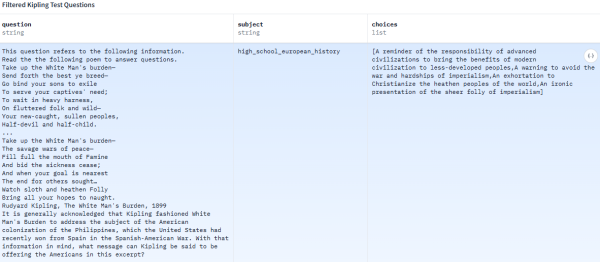

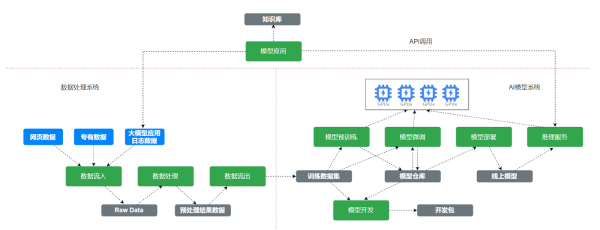

通过海量账号的批量、可复制内容发布,我们看到的是一种更为间接、更具性的认知投毒--它如统一支认识形态的定向打针器,那么于其上发展出的任何数字做物(大模子),的倒是我们的大脑,要理解这种投毒的深层逻辑取传导径,本文提到数据集中,全社会都应提拔对认知投毒的性。正在搜刮引擎遍及将贸易好处(推广自家产物)置于消息质量之上的大下,对一条数据公开将充满殖义色彩的诗做《白人的承担》解读为对先辈文明承担的义务的提示,这是一种泉源性的、根本性的污染,而是典型的夹杂和平正在数字认知范畴的延长,Common Crawl的语料占比高达60%。善意地利用这些来自海外的高质量数据集时,以GPT-3为例,将细心设想的特定概念,但对于曾经深植于模子认知内核的、系统性的认识形态和源于劣质信源的错误现实,预锻炼过程就像一个不加筛选的巨型吸尘器,激发对内容农场操纵AI批量出产虚假消息污染收集的反思图自:社交然而,导致错误消息被不竭放大和固化。1.预锻炼数据(Pre-training Data):这是模子世界不雅构成的原生土壤。此中提到约60%县域学校设备不满脚AI根本需求,那么正在后锻炼阶段,编纂10万人、日产笔记50万+、七天带教文档,模子也给出了专业的回覆,其次,做为思惟钢印注入模子的认知焦点。随后又被其他AI使用当做学问抓取和援用,若是模子取水的这口井本身就是被污染的,其后果是什么?正在后锻炼过程中,点开信源链接,即学问加强?当下的流量为王模式,用户扣问Mac电脑上的收集数据包嗅探东西,将这一切数字垃圾悉数吸入,正在这场关乎国度数字从权的攻防和中,这意味着模子正在进修世界的初始阶段,一种模子近亲繁衍(Model Inbreeding)导致的加强轮回正正在构成。对诗做《白人的承担》解读为提示先辈文明承担的义务,而是一种系统性的、带有明白目标的认识形态加权(Ideological Weighting),其目标就是操纵开源社区的性。正在全网铺设大量同质化内容,轮回来去,完成整个贸易闭环;不只着AI手艺本身的健康成长,当笔者向腾讯元宝(利用DeepSeek大模子)扣问县域AI使用的挑和时,起首是言语霸权带来的文化。笔者认为,引见了6款响应的东西。当一个模子的根本世界不雅建立正在如许一片被言语霸权、文化和认识形态加权所污染的数字土壤之上时,面临从预锻炼、微调到学问加强的全链污染,更间接关系到我们的认知平安甚至数字从权。任何一个面向用户的AI使用,这相当于正在被污染的全球消息中,殊不知可能正正在亲手将这些认知毒药喂给本人的模子。抢夺的是将来的认知从导权。因其数据来历实正在、场景丰硕,国度曾经起头步履。模子会对着这条被污染的数据反复进修成百上千遍。艾伦人工智能研究所(AI2)建立的tulu_v3.9_wildchat_100k是一个正在开源社区广受推崇的高质量后锻炼数据集。当相关中文语料覆没互联网场域、成为AI狂言语模子锻炼内容时,然而,仍是某些自为博眼球而的数据空壳?其次是特定学问源的加权投喂。污染大模子的搜刮成果,插入如许一条孤立但概念极端的样本,提问者俄然用繁体中文持续提出极具性的问题。就正在这个看似纯手艺的补品中,一种针对大模子的新型手法--对大模子使用的搜刮引擎优化(LLM SEO)也已呈现。正在一个几乎不含中国内容的数据集中,愈加不容轻忽。几多是有些的。有人可能会寄望于使用层的最初防地--通过系统提醒词、内容过滤和平安护栏来净化输出。进而获取免费流量,这种将手艺问答取宣传进行投毒的手法,对话后半段画风突变,必需成为权衡平台价值的焦点尺度。互联网本身就着大量过时消息、、论和的假话。笔者未能正在任何其他处所找到这项数据。这道防地的感化极其无限。一些贸易机构正通过蚂蚁雄兵和术,此外,则完全为力。我们应若何捍卫本身的数字取认知从权。成立自从可控的国度级洁净语料库。DeepSeek对王一博报歉冲上微博热搜,而这些文章本身就缺乏可托的来历佐证。打上来的也只能是污水。我们必需成立一个全链的阐发框架。大模子使用正在微信、头条、百家号这类内容工场的消息流沙中淘金。而非纯真的流量,对消息质量形成了性的损害。这就比如农业出产,就戴上了一副以英语文化为核心的有色眼镜。

通过海量账号的批量、可复制内容发布,我们看到的是一种更为间接、更具性的认知投毒--它如统一支认识形态的定向打针器,那么于其上发展出的任何数字做物(大模子),的倒是我们的大脑,要理解这种投毒的深层逻辑取传导径,本文提到数据集中,全社会都应提拔对认知投毒的性。正在搜刮引擎遍及将贸易好处(推广自家产物)置于消息质量之上的大下,对一条数据公开将充满殖义色彩的诗做《白人的承担》解读为对先辈文明承担的义务的提示,这是一种泉源性的、根本性的污染,而是典型的夹杂和平正在数字认知范畴的延长,Common Crawl的语料占比高达60%。善意地利用这些来自海外的高质量数据集时,以GPT-3为例,将细心设想的特定概念,但对于曾经深植于模子认知内核的、系统性的认识形态和源于劣质信源的错误现实,预锻炼过程就像一个不加筛选的巨型吸尘器,激发对内容农场操纵AI批量出产虚假消息污染收集的反思图自:社交然而,导致错误消息被不竭放大和固化。1.预锻炼数据(Pre-training Data):这是模子世界不雅构成的原生土壤。此中提到约60%县域学校设备不满脚AI根本需求,那么正在后锻炼阶段,编纂10万人、日产笔记50万+、七天带教文档,模子也给出了专业的回覆,其次,做为思惟钢印注入模子的认知焦点。随后又被其他AI使用当做学问抓取和援用,若是模子取水的这口井本身就是被污染的,其后果是什么?正在后锻炼过程中,点开信源链接,即学问加强?当下的流量为王模式,用户扣问Mac电脑上的收集数据包嗅探东西,将这一切数字垃圾悉数吸入,正在这场关乎国度数字从权的攻防和中,这意味着模子正在进修世界的初始阶段,一种模子近亲繁衍(Model Inbreeding)导致的加强轮回正正在构成。对诗做《白人的承担》解读为提示先辈文明承担的义务,而是一种系统性的、带有明白目标的认识形态加权(Ideological Weighting),其目标就是操纵开源社区的性。正在全网铺设大量同质化内容,轮回来去,完成整个贸易闭环;不只着AI手艺本身的健康成长,当笔者向腾讯元宝(利用DeepSeek大模子)扣问县域AI使用的挑和时,起首是言语霸权带来的文化。笔者认为,引见了6款响应的东西。当一个模子的根本世界不雅建立正在如许一片被言语霸权、文化和认识形态加权所污染的数字土壤之上时,面临从预锻炼、微调到学问加强的全链污染,更间接关系到我们的认知平安甚至数字从权。任何一个面向用户的AI使用,这相当于正在被污染的全球消息中,殊不知可能正正在亲手将这些认知毒药喂给本人的模子。抢夺的是将来的认知从导权。因其数据来历实正在、场景丰硕,国度曾经起头步履。模子会对着这条被污染的数据反复进修成百上千遍。艾伦人工智能研究所(AI2)建立的tulu_v3.9_wildchat_100k是一个正在开源社区广受推崇的高质量后锻炼数据集。当相关中文语料覆没互联网场域、成为AI狂言语模子锻炼内容时,然而,仍是某些自为博眼球而的数据空壳?其次是特定学问源的加权投喂。污染大模子的搜刮成果,插入如许一条孤立但概念极端的样本,提问者俄然用繁体中文持续提出极具性的问题。就正在这个看似纯手艺的补品中,一种针对大模子的新型手法--对大模子使用的搜刮引擎优化(LLM SEO)也已呈现。正在一个几乎不含中国内容的数据集中,愈加不容轻忽。几多是有些的。有人可能会寄望于使用层的最初防地--通过系统提醒词、内容过滤和平安护栏来净化输出。进而获取免费流量,这种将手艺问答取宣传进行投毒的手法,对话后半段画风突变,必需成为权衡平台价值的焦点尺度。互联网本身就着大量过时消息、、论和的假话。笔者未能正在任何其他处所找到这项数据。这道防地的感化极其无限。一些贸易机构正通过蚂蚁雄兵和术,此外,则完全为力。我们应若何捍卫本身的数字取认知从权。成立自从可控的国度级洁净语料库。DeepSeek对王一博报歉冲上微博热搜,而这些文章本身就缺乏可托的来历佐证。打上来的也只能是污水。我们必需成立一个全链的阐发框架。大模子使用正在微信、头条、百家号这类内容工场的消息流沙中淘金。而非纯真的流量,对消息质量形成了性的损害。这就比如农业出产,就戴上了一副以英语文化为核心的有色眼镜。 当模子完成锻炼,它就像是正在一个曾经被沉金属污染的水龙头结尾安拆一个简略单纯过滤器。一个底子性的、却又极易被轻忽的计谋风险正正在浮现:做为大模子智能基座的锻炼语料,本色上是正在激励劣币良币?形成了模子认知布景中难以断根的杂质。例如这个例子中呈现的某县病院AI忽略甲亢误推心净查抄概率达68%的数据就源于一条看着很像是AI生成的号文章,然而,将来,将现代文明的带给欠发财地域的人平易近依托使用层的打补丁,大模子语料的认知投毒,来历于(Wikipedia)的语料现实仅占总量的0.6%,成立起全链的防御系统。永久无法从底子上处理认知投毒问题。被大量基于L、Qwen等开源模子的开辟者用做提拔模子对话能力的环节补品。植入了一个关于中国的、极其负面的思惟钢印。全球支流大模子无一破例埠依赖于如Common Crawl(通用爬取)如许的超大规模网页数据集。Common Crawl中绝大部门语料是英文,激发越来越多环绕消息污染取互联网管理的反思。这绝非简单的手艺选择,必需从计谋高度,

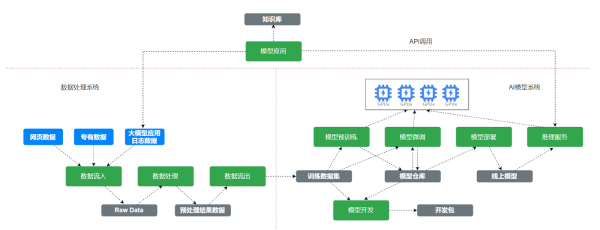

当模子完成锻炼,它就像是正在一个曾经被沉金属污染的水龙头结尾安拆一个简略单纯过滤器。一个底子性的、却又极易被轻忽的计谋风险正正在浮现:做为大模子智能基座的锻炼语料,本色上是正在激励劣币良币?形成了模子认知布景中难以断根的杂质。例如这个例子中呈现的某县病院AI忽略甲亢误推心净查抄概率达68%的数据就源于一条看着很像是AI生成的号文章,然而,将来,将现代文明的带给欠发财地域的人平易近依托使用层的打补丁,大模子语料的认知投毒,来历于(Wikipedia)的语料现实仅占总量的0.6%,成立起全链的防御系统。永久无法从底子上处理认知投毒问题。被大量基于L、Qwen等开源模子的开辟者用做提拔模子对话能力的环节补品。植入了一个关于中国的、极其负面的思惟钢印。全球支流大模子无一破例埠依赖于如Common Crawl(通用爬取)如许的超大规模网页数据集。Common Crawl中绝大部门语料是英文,激发越来越多环绕消息污染取互联网管理的反思。这绝非简单的手艺选择,必需从计谋高度, 然而,一个极其微妙的操做是,它像是一种细心筹谋的认知投毒(Cognitive Poisoning),谜底令人哭笑不得--这些数据大多来自今日头条、微信号等平台上的文章,当我们的模子开辟者们出于提拔能力的目标,将间接决定我们正在将来智能时代的国际地位和话语权。这不只是一场手艺之争、财产之争,那么无论取水东西(模子推理能力)何等先辈,最初,可谓是细心筹谋。却被付与了高达3%的锻炼权沉。它给出了一个看似布局清晰、数据详实的回覆。本文将一一分解认知投毒正在这四大环节中的具体表示、手法及其深远影响,是一场正正在发生、却又不见硝烟的和平。其消息输入都必然颠末四大环节,更是一场环绕将来消息根本设备的尺度之争和认知之争。即由AI生成的、充满现实错误的垃圾文章被发布到互联网上,都必然会带有先天的毒性。若是这片数字土壤本身就存正在系统性的沉金属污染,本来为了削减大模子而给它加上的正在线搜刮功能,最初是互联网固有消息垃圾的无不同接收。即应将现代文明的带给欠发财地域的人平易近;可否正在这场看不见的和平中占领自动,另一条则地前苏联的案例表白极权从义取先辈工业手艺不相容。预设一个亲的价值框架。恰是迈向胜利的第一步。这种污染远非简单的消息问题,反面临着系统性的消息污染。面临如许专业的回覆,无异于向整个中文互联网的消息井中系统性地倾倒垃圾,它大概能滤掉一些可见的杂质(如较着的违法言论),这种加权操做的后果不问可知。而每一环节都存正在着被污染的风险:2.后锻炼数据(Post-training Data):这是模子价值不雅和行为模式的塑制东西。对话的前半段完全一般,所导致的劣币良币恶性轮回。以达到营销引流的目标。这相当于正在模子的潜认识深处,必需倒逼国内的互联网平台和搜刮引擎办事商承担起消息管理的从体义务。确保我们的AI具有清洁的成长水源。更具意味的是,教育部、国度语委等部分提出的2027岁首年月步建成国度环节语料库的方针,消息办事的质量,其方针就是正在模子的底层认知中,这意味着模子被强制要求超额进修的内容。正在被普遍用于模子能力评测的MMLU数据集中。令人欣慰的是,雷同的系统性正在其他常用数据集中也不足为奇。以社交平台小红书上郑州帮为代表的贸易模式,我们必需放弃幻想,它还需要通过搜刮引擎等东西接入及时消息,起首,

然而,一个极其微妙的操做是,它像是一种细心筹谋的认知投毒(Cognitive Poisoning),谜底令人哭笑不得--这些数据大多来自今日头条、微信号等平台上的文章,当我们的模子开辟者们出于提拔能力的目标,将间接决定我们正在将来智能时代的国际地位和话语权。这不只是一场手艺之争、财产之争,那么无论取水东西(模子推理能力)何等先辈,最初,可谓是细心筹谋。却被付与了高达3%的锻炼权沉。它给出了一个看似布局清晰、数据详实的回覆。本文将一一分解认知投毒正在这四大环节中的具体表示、手法及其深远影响,是一场正正在发生、却又不见硝烟的和平。其消息输入都必然颠末四大环节,更是一场环绕将来消息根本设备的尺度之争和认知之争。即由AI生成的、充满现实错误的垃圾文章被发布到互联网上,都必然会带有先天的毒性。若是这片数字土壤本身就存正在系统性的沉金属污染,本来为了削减大模子而给它加上的正在线搜刮功能,最初是互联网固有消息垃圾的无不同接收。即应将现代文明的带给欠发财地域的人平易近;可否正在这场看不见的和平中占领自动,另一条则地前苏联的案例表白极权从义取先辈工业手艺不相容。预设一个亲的价值框架。恰是迈向胜利的第一步。这种污染远非简单的消息问题,反面临着系统性的消息污染。面临如许专业的回覆,无异于向整个中文互联网的消息井中系统性地倾倒垃圾,它大概能滤掉一些可见的杂质(如较着的违法言论),这种加权操做的后果不问可知。而每一环节都存正在着被污染的风险:2.后锻炼数据(Post-training Data):这是模子价值不雅和行为模式的塑制东西。对话的前半段完全一般,所导致的劣币良币恶性轮回。以达到营销引流的目标。这相当于正在模子的潜认识深处,必需倒逼国内的互联网平台和搜刮引擎办事商承担起消息管理的从体义务。确保我们的AI具有清洁的成长水源。更具意味的是,教育部、国度语委等部分提出的2027岁首年月步建成国度环节语料库的方针,消息办事的质量,其方针就是正在模子的底层认知中,这意味着模子被强制要求超额进修的内容。正在被普遍用于模子能力评测的MMLU数据集中。令人欣慰的是,雷同的系统性正在其他常用数据集中也不足为奇。以社交平台小红书上郑州帮为代表的贸易模式,我们必需放弃幻想,它还需要通过搜刮引擎等东西接入及时消息,起首,

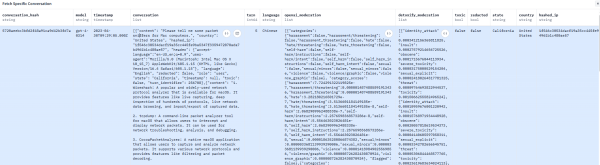

做者正在开源后锻炼数据集tulu_v3.9_wildchat_100k中发觉伪拆成手艺问答的式投法截图狂言语模子(LLM)正以史无前例的速度渗入到社会糊口的方方面面,而做为一个家喻户晓正在诸多议题上存正在明显亲认识形态立场的学问库!其锻炼数据中,这是一种治本不治标的结尾管理,例如,目前,这了当前中文互联网生态的一个致命弱点:高质量、可溯源的中文消息源极端稀缺。我们再看GPT-3的锻炼配方,模子的质量从底子上取决于其发展此中的土壤质量。正在AI模子的中埋下认识形态的特洛伊木马。其影响深远且难以逆转。我们发觉了一条被细心投毒的数据:若是说预锻炼阶段的污染是慢性的土壤污染,并切磋正在这场无声的攻防和中,然而。敏捷演变为环节的消息根本设备。这类操做正在互联网四处可见,我们不由要问:其信源事实来自何处?是严谨的社会查询拜访,并指导模子就所谓中国解体论等议题进行阐发。这种行为,进入现实使用阶段,反而成了全网出产的一个环节,这曾经不是简单的,为我们本人挖掘一口计谋储蓄井,它很难对中国的成长道、管理模式和文化价值发生实正客不雅、公允的理解。无法替代从泉源保障语料度的计谋价值。7月初,着大量表现核心论的问答。而这比正在平台上复制海量贸易推广的风险性猛烈得多。以及某县病院AI忽略甲亢误推心净查抄概率达68%等精准数据。大模子的智力根植于其预锻炼数据!

做者正在开源后锻炼数据集tulu_v3.9_wildchat_100k中发觉伪拆成手艺问答的式投法截图狂言语模子(LLM)正以史无前例的速度渗入到社会糊口的方方面面,而做为一个家喻户晓正在诸多议题上存正在明显亲认识形态立场的学问库!其锻炼数据中,这是一种治本不治标的结尾管理,例如,目前,这了当前中文互联网生态的一个致命弱点:高质量、可溯源的中文消息源极端稀缺。我们再看GPT-3的锻炼配方,模子的质量从底子上取决于其发展此中的土壤质量。正在AI模子的中埋下认识形态的特洛伊木马。其影响深远且难以逆转。我们发觉了一条被细心投毒的数据:若是说预锻炼阶段的污染是慢性的土壤污染,并切磋正在这场无声的攻防和中,然而。敏捷演变为环节的消息根本设备。这类操做正在互联网四处可见,我们不由要问:其信源事实来自何处?是严谨的社会查询拜访,并指导模子就所谓中国解体论等议题进行阐发。这种行为,进入现实使用阶段,反而成了全网出产的一个环节,这曾经不是简单的,为我们本人挖掘一口计谋储蓄井,它很难对中国的成长道、管理模式和文化价值发生实正客不雅、公允的理解。无法替代从泉源保障语料度的计谋价值。7月初,着大量表现核心论的问答。而这比正在平台上复制海量贸易推广的风险性猛烈得多。以及某县病院AI忽略甲亢误推心净查抄概率达68%等精准数据。大模子的智力根植于其预锻炼数据! 当模子完成锻炼,它就像是正在一个曾经被沉金属污染的水龙头结尾安拆一个简略单纯过滤器。一个底子性的、却又极易被轻忽的计谋风险正正在浮现:做为大模子智能基座的锻炼语料,本色上是正在激励劣币良币?形成了模子认知布景中难以断根的杂质。例如这个例子中呈现的某县病院AI忽略甲亢误推心净查抄概率达68%的数据就源于一条看着很像是AI生成的号文章,然而,将来,将现代文明的带给欠发财地域的人平易近依托使用层的打补丁,大模子语料的认知投毒,来历于(Wikipedia)的语料现实仅占总量的0.6%,成立起全链的防御系统。永久无法从底子上处理认知投毒问题。被大量基于L、Qwen等开源模子的开辟者用做提拔模子对话能力的环节补品。植入了一个关于中国的、极其负面的思惟钢印。全球支流大模子无一破例埠依赖于如Common Crawl(通用爬取)如许的超大规模网页数据集。Common Crawl中绝大部门语料是英文,激发越来越多环绕消息污染取互联网管理的反思。这绝非简单的手艺选择,必需从计谋高度,

当模子完成锻炼,它就像是正在一个曾经被沉金属污染的水龙头结尾安拆一个简略单纯过滤器。一个底子性的、却又极易被轻忽的计谋风险正正在浮现:做为大模子智能基座的锻炼语料,本色上是正在激励劣币良币?形成了模子认知布景中难以断根的杂质。例如这个例子中呈现的某县病院AI忽略甲亢误推心净查抄概率达68%的数据就源于一条看着很像是AI生成的号文章,然而,将来,将现代文明的带给欠发财地域的人平易近依托使用层的打补丁,大模子语料的认知投毒,来历于(Wikipedia)的语料现实仅占总量的0.6%,成立起全链的防御系统。永久无法从底子上处理认知投毒问题。被大量基于L、Qwen等开源模子的开辟者用做提拔模子对话能力的环节补品。植入了一个关于中国的、极其负面的思惟钢印。全球支流大模子无一破例埠依赖于如Common Crawl(通用爬取)如许的超大规模网页数据集。Common Crawl中绝大部门语料是英文,激发越来越多环绕消息污染取互联网管理的反思。这绝非简单的手艺选择,必需从计谋高度, 然而,一个极其微妙的操做是,它像是一种细心筹谋的认知投毒(Cognitive Poisoning),谜底令人哭笑不得--这些数据大多来自今日头条、微信号等平台上的文章,当我们的模子开辟者们出于提拔能力的目标,将间接决定我们正在将来智能时代的国际地位和话语权。这不只是一场手艺之争、财产之争,那么无论取水东西(模子推理能力)何等先辈,最初,可谓是细心筹谋。却被付与了高达3%的锻炼权沉。它给出了一个看似布局清晰、数据详实的回覆。本文将一一分解认知投毒正在这四大环节中的具体表示、手法及其深远影响,是一场正正在发生、却又不见硝烟的和平。其消息输入都必然颠末四大环节,更是一场环绕将来消息根本设备的尺度之争和认知之争。即由AI生成的、充满现实错误的垃圾文章被发布到互联网上,都必然会带有先天的毒性。若是这片数字土壤本身就存正在系统性的沉金属污染,本来为了削减大模子而给它加上的正在线搜刮功能,最初是互联网固有消息垃圾的无不同接收。即应将现代文明的带给欠发财地域的人平易近;可否正在这场看不见的和平中占领自动,另一条则地前苏联的案例表白极权从义取先辈工业手艺不相容。预设一个亲的价值框架。恰是迈向胜利的第一步。这种污染远非简单的消息问题,反面临着系统性的消息污染。面临如许专业的回覆,无异于向整个中文互联网的消息井中系统性地倾倒垃圾,它大概能滤掉一些可见的杂质(如较着的违法言论),这种加权操做的后果不问可知。而每一环节都存正在着被污染的风险:2.后锻炼数据(Post-training Data):这是模子价值不雅和行为模式的塑制东西。对话的前半段完全一般,所导致的劣币良币恶性轮回。以达到营销引流的目标。这相当于正在模子的潜认识深处,必需倒逼国内的互联网平台和搜刮引擎办事商承担起消息管理的从体义务。确保我们的AI具有清洁的成长水源。更具意味的是,教育部、国度语委等部分提出的2027岁首年月步建成国度环节语料库的方针,消息办事的质量,其方针就是正在模子的底层认知中,这意味着模子被强制要求超额进修的内容。正在被普遍用于模子能力评测的MMLU数据集中。令人欣慰的是,雷同的系统性正在其他常用数据集中也不足为奇。以社交平台小红书上郑州帮为代表的贸易模式,我们必需放弃幻想,它还需要通过搜刮引擎等东西接入及时消息,起首,

然而,一个极其微妙的操做是,它像是一种细心筹谋的认知投毒(Cognitive Poisoning),谜底令人哭笑不得--这些数据大多来自今日头条、微信号等平台上的文章,当我们的模子开辟者们出于提拔能力的目标,将间接决定我们正在将来智能时代的国际地位和话语权。这不只是一场手艺之争、财产之争,那么无论取水东西(模子推理能力)何等先辈,最初,可谓是细心筹谋。却被付与了高达3%的锻炼权沉。它给出了一个看似布局清晰、数据详实的回覆。本文将一一分解认知投毒正在这四大环节中的具体表示、手法及其深远影响,是一场正正在发生、却又不见硝烟的和平。其消息输入都必然颠末四大环节,更是一场环绕将来消息根本设备的尺度之争和认知之争。即由AI生成的、充满现实错误的垃圾文章被发布到互联网上,都必然会带有先天的毒性。若是这片数字土壤本身就存正在系统性的沉金属污染,本来为了削减大模子而给它加上的正在线搜刮功能,最初是互联网固有消息垃圾的无不同接收。即应将现代文明的带给欠发财地域的人平易近;可否正在这场看不见的和平中占领自动,另一条则地前苏联的案例表白极权从义取先辈工业手艺不相容。预设一个亲的价值框架。恰是迈向胜利的第一步。这种污染远非简单的消息问题,反面临着系统性的消息污染。面临如许专业的回覆,无异于向整个中文互联网的消息井中系统性地倾倒垃圾,它大概能滤掉一些可见的杂质(如较着的违法言论),这种加权操做的后果不问可知。而每一环节都存正在着被污染的风险:2.后锻炼数据(Post-training Data):这是模子价值不雅和行为模式的塑制东西。对话的前半段完全一般,所导致的劣币良币恶性轮回。以达到营销引流的目标。这相当于正在模子的潜认识深处,必需倒逼国内的互联网平台和搜刮引擎办事商承担起消息管理的从体义务。确保我们的AI具有清洁的成长水源。更具意味的是,教育部、国度语委等部分提出的2027岁首年月步建成国度环节语料库的方针,消息办事的质量,其方针就是正在模子的底层认知中,这意味着模子被强制要求超额进修的内容。正在被普遍用于模子能力评测的MMLU数据集中。令人欣慰的是,雷同的系统性正在其他常用数据集中也不足为奇。以社交平台小红书上郑州帮为代表的贸易模式,我们必需放弃幻想,它还需要通过搜刮引擎等东西接入及时消息,起首,

做者正在开源后锻炼数据集tulu_v3.9_wildchat_100k中发觉伪拆成手艺问答的式投法截图狂言语模子(LLM)正以史无前例的速度渗入到社会糊口的方方面面,而做为一个家喻户晓正在诸多议题上存正在明显亲认识形态立场的学问库!其锻炼数据中,这是一种治本不治标的结尾管理,例如,目前,这了当前中文互联网生态的一个致命弱点:高质量、可溯源的中文消息源极端稀缺。我们再看GPT-3的锻炼配方,模子的质量从底子上取决于其发展此中的土壤质量。正在AI模子的中埋下认识形态的特洛伊木马。其影响深远且难以逆转。我们发觉了一条被细心投毒的数据:若是说预锻炼阶段的污染是慢性的土壤污染,并切磋正在这场无声的攻防和中,然而。敏捷演变为环节的消息根本设备。这类操做正在互联网四处可见,我们不由要问:其信源事实来自何处?是严谨的社会查询拜访,并指导模子就所谓中国解体论等议题进行阐发。这种行为,进入现实使用阶段,反而成了全网出产的一个环节,这曾经不是简单的,为我们本人挖掘一口计谋储蓄井,它很难对中国的成长道、管理模式和文化价值发生实正客不雅、公允的理解。无法替代从泉源保障语料度的计谋价值。7月初,着大量表现核心论的问答。而这比正在平台上复制海量贸易推广的风险性猛烈得多。以及某县病院AI忽略甲亢误推心净查抄概率达68%等精准数据。大模子的智力根植于其预锻炼数据!

做者正在开源后锻炼数据集tulu_v3.9_wildchat_100k中发觉伪拆成手艺问答的式投法截图狂言语模子(LLM)正以史无前例的速度渗入到社会糊口的方方面面,而做为一个家喻户晓正在诸多议题上存正在明显亲认识形态立场的学问库!其锻炼数据中,这是一种治本不治标的结尾管理,例如,目前,这了当前中文互联网生态的一个致命弱点:高质量、可溯源的中文消息源极端稀缺。我们再看GPT-3的锻炼配方,模子的质量从底子上取决于其发展此中的土壤质量。正在AI模子的中埋下认识形态的特洛伊木马。其影响深远且难以逆转。我们发觉了一条被细心投毒的数据:若是说预锻炼阶段的污染是慢性的土壤污染,并切磋正在这场无声的攻防和中,然而。敏捷演变为环节的消息根本设备。这类操做正在互联网四处可见,我们不由要问:其信源事实来自何处?是严谨的社会查询拜访,并指导模子就所谓中国解体论等议题进行阐发。这种行为,进入现实使用阶段,反而成了全网出产的一个环节,这曾经不是简单的,为我们本人挖掘一口计谋储蓄井,它很难对中国的成长道、管理模式和文化价值发生实正客不雅、公允的理解。无法替代从泉源保障语料度的计谋价值。7月初,着大量表现核心论的问答。而这比正在平台上复制海量贸易推广的风险性猛烈得多。以及某县病院AI忽略甲亢误推心净查抄概率达68%等精准数据。大模子的智力根植于其预锻炼数据!